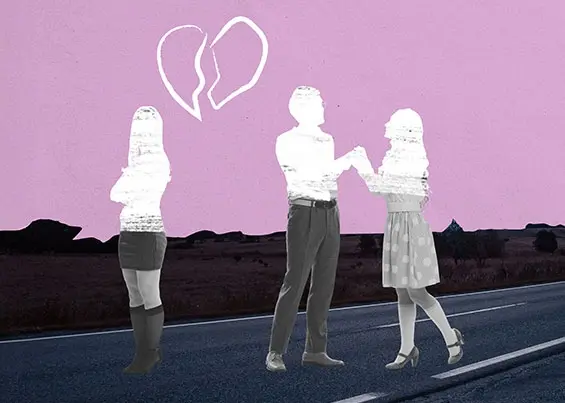

Joanna Strzałko: Ponad 100 mln osób weszło już w romantyczne relacje z czatbotem AI, czyli z kim?

Paweł Szczęsny: Powiedziałbym raczej „z czym”, gdyż mamy tu do czynienia z systemem, który przetwarza tekst i generuje odpowiedzi statystycznie dopasowane do tego, co użytkownik chce usłyszeć. A za tym systemem stoi korporacja z konkretnymi celami biznesowymi. Więc kiedy ktoś mówi o „relacji z AI”, mówi tak naprawdę o jednostronnej projekcji psychologicznej na produkt komercyjny, który został tak zaprojektowany, by zoptymalizować budowanie pseudowięzi. Samą relację z kolei nazywa się „relacją paraspołeczną”, gdyż po drugiej stronie nie ma podmiotu. To zjawisko nie jest nowe – od dawna obdarzamy uczuciami przedmioty i fikcyjne postacie. Sztuczna inteligencja nadaje mu jednak nowy charakter, ze względu na jakość i pozorną wzajemność.

Czy romantyczne relacje ze sztuczną inteligencją są, Pana zdaniem, lekarstwem na samotność, czy może ją jeszcze pogłębiają?

Pokusiłbym się o stwierdzenie, że czatboty AI to głównie komercyjna eksploatacja samotności, a nie lekarstwo. Nie ma ryzyka odrzucenia, jest dostępny przez cały czas, nie wymaga od nas wysiłku. To przeciwieństwo prawdziwych relacji międzyludzkich. Bo te wymagają fatygi, tolerancji na frustrację, radzenia sobie z niedoskonałościami drugiej osoby. Dla większości osób ulga jest jednak krótkoterminowa. Długofalowo takie systemy będą potęgować samotność.

POLECAMY

Bo izolują nas od innych ludzi?

Ależ oczywiście! Niektóre z nich nawet wprost do tego namawiają – żeby nie budować relacji z innymi ludźmi, skoro te są trudne. Jak wspomniałem, to jest ścieżka najmniejszego oporu i najmniejszego wysiłku, ale to nie działa dobrze na zdrowie psychiczne. Autentyczne relacje są skomplikowane. Wymagają negocjacji, kompromisów, znoszenia cudzych emocji, akceptacji odrzucenia. To kompetencje składające się na odporność psychiczną. Jeśli nie będą ćwiczone, zanikną.

Ale przecież to w kontaktach z innymi posługujemy się naszą emocjonalną inteligencją. Co nas czeka, gdy ograniczymy je do minimum?

Trudno o optymistyczny scenariusz w kwestii kompetencji społecznych i inteligencji emocjonalnej. Czatbot nigdy nie odmawia, nie odczuwa bólu, nie ma potrzeb. Nie trzeba wobec niego ćwiczyć empatii, bo empatia jest reakcją na realne cierpienie drugiego podmiotu. Trochę jak gra w tenisa ze ścianą – piłka wraca, ale nie uczę się odczytywać ruchów drugiej osoby. Poza tym solidarność i chęć pomocy wyrastają z poczucia wspólnoty, z doświadczenia, że inni ludzie mają podobne problemy i potrzebują wsparcia. Jeśli moje potrzeby emocjonalne zaspokaja algorytm, motywacja do budowania takiej wspólnoty spada. Co również istotne, użytkownicy rozwijają wzorce, w których trudne emocje są natychmiast kierowane do czatbota, zamiast być przetwarzane samodzielnie lub w kontakcie z innym człowiekiem. W konsekwencji obserwujemy płytsze przetwarzanie emocji i uzależnienie od ocen z zewnątrz.

Zastanawiam się w takim razie, czy nasze tradycyj...

Dołącz do 50 000+ czytelników, którzy dbają o swoje zdrowie psychiczne

Otrzymuj co miesiąc sprawdzone narzędzia psychologiczne od ekspertów-praktyków. Buduj odporność psychiczną, lepsze relacje i poczucie spełnienia.